Pandemie der falschen Experten

Neben Covid-19 grassiert auch noch eine Fake News- und Pseudoexperten-Pandemie. Ein kurzes Who’s Who der häufigsten Scheinargumente und Trugschlüsse.

Würden Sie sich bei einer Covid-19-Erkrankung freiwillig von einem offensichtlichen Vollidioten und Quacksalber behandeln lassen? Vermutlich nicht. In manchen Fällen ist die Antwort dennoch ja. Es gibt genug Menschen, die den pseudowissenschaftlichen Äußerungen von Influencern, Promis und leider auch vermeintlichen Experten aufsitzen. Wenn Donald Trump also eine Ärztin “spektakulär” und “sehr beeindruckend” nennt, lohnt es sich, einen genaueren Blick darauf zu werfen. Dr. Stella Immanuel ist Houstoner Ärztin und hat bekanntermaßen vor kurzem öffentlich ein paar denkwürdige Aussagen vom Stapel gelassen. Arbeiten wir uns entlang des Bullshit-Grades zu den Highlights vor. Immanuel empfiehlt zuerst, Hydroxychloroquin im Kampf gegen Covid-19 einzusetzen.

Hydroxychloroquin ist ein Medikament zur Malariabehandlung und -prophylaxe, das anfangs als Heilsbringer gegen Covid-19-Infektionen gehandelt wurde. Eine Studie, die eine Wirksamkeit zeigen sollte, hat The Lancet hurtig zurückgezogen, nachdem drei von vier Autoren Zweifel an ihren Daten äußerten. Die Nebenwirkungen von Hydroxychloroquin sind auch nicht ohne: Sehstörungen und Veränderungen der Hornhaut, die bei 10 bis 20 Prozent der Patienten auftreten können, wirken noch vergleichsweise harmlos. Herzrhythmusstörungen in Verbindung mit einigen Antibiotika, die zum Tod führen können, scheinen da schon schlimmer, wie die US-amerikanische Arzneimittelbehörde FDA schreibt. Sei’s drum: Dr. Immanuel, um die sich eine Medizinergruppe mit dem Namen „Amerikas Front-Ärzte“ schart, spricht sich in ihrem Vortrag anlässlich des “Weißkittelgipfels” Ende Juli vor dem US-Kongress offen für die Anwendung des Entzündungshemmers aus. Sie habe es in hunderten Fällen angewandt, darunter bei sich selbst und ihrem Team. Ob es ihre Denkfähigkeit beeinträchtigt hat, sagte Immanuel hingegen nicht. Dabei deutet einiges darauf hin.

Züchtet Harry Potter mit Dämonensperma eine Armee von Reptiloiden?

Dr. Immanuel glaubt daran, dass Masturbation und Sexträume Dämonen heraufbeschwören, und dass deren Sperma wiederum die Ursache gynäkologischer Beschwerden sei. Die Ärztin empfiehlt im Kampf gegen Covid-19 außerdem die Einnahme von Zink und Zithromax. Während ersteres ein im Kampf gegen Viren gänzlich unwirksames Spurenelement ist, ist letzteres ein Medikament, das unter anderem gegen übertragbare Sexualkrankheiten wie Chlamydien und Tripper zum Einsatz kommt. Daneben vertritt sie weniger medizinischen als viel mehr verschwörungstheoretischen Mumpitz wie jenen, dass Alien-DNA in Medikamente eingeschleust wird und dass die US-Regierung von außerirdischen Reptiloiden unterwandert ist. Umso bemerkenswerter der Mut der Front-Ärzte, sich vor den US-Kongress in Washington D.C. zu trauen. Das Video wurde unter anderem von Trump und Popsängerin Madonna (“Immanuel ist meine Heldin”) weiterverbreitet und mittlerweile von YouTube, Facebook und Twitter entfernt.

Unerwünscht: Geht es nach Dr. Immanuel, ist Harry Potter, zusammen mit Hannah Montana und Waverly Place, Schuld am angeblichen Niedergang der Menschheit. Quelle: Flickr/Flywithinsun

Wenn Wissenschaft und Interessen kollidieren

Immanuel ist Ärztin mit einem medizinischen Doktorgrad der University of Calabar in Nigeria und einer Arztzulassung in den USA. Das klingt erstmal nach einer Wissenschaftlerin. Immanuel ist allerdings auch medizinisch vorbelastet: 2019 lässt die Ärztin nach einer Injektion eine abgebrochene Nadel in der Wunde einer Patientin stecken. Sechs Tage darauf stirbt die Patientin an einer Infektion (niemand kann sagen, ob masturbations-induzierte Dämonen daran beteiligt waren). Immanuel flieht aus Louisiana nach Texas, um einer Strafverfolgung zu entgehen. Dort eröffnet sie eine neue Praxis in einem Shoppingcenter.

Nebenbei ist Immanuel Pastorin einer missionarischen Kirche und verbreitet (höflich formuliert) fragwürdige Theorien über Homosexualität und “homosexuellen Terrorismus”. Die Illuminati würden Hexen verwenden, um mittels Abtreibung, gleichgeschlechtlicher Ehen und (festhalten!) Harry Potter die Welt aus den Angeln zu heben. Wissenschaftler würden laut Immanuel zudem an Impfstoffen gegen Religionen arbeiten. Ihre Auswüchse lesen sich so, als hätte jemand alle Verschwörungstheorien der Welt in einen Mixer gedrückt und diesen auf Maximalstufe gedreht.

Ungebremst: Medizinerin und Pastorin Dr. Stella Immanuel erklärt in einem Video anhand von “anekdotischer Evidenz”, wie angeblich böse Geister Besitz von einer Freundin ergriffen haben und sie deshalb an Brustkrebs erkrankte. Quelle: YouTube/DrStellaImmanuel

Sogar, wenn die Ärztin nicht antiwissenschaftlich vorginge und offensichtlich einen an der Waffel hätte: Es offenbart sich noch ein weiteres Problem. Immanuel ist Kinderärztin, also weder Virologin noch Epidemiologin. Es ist medial des Öfteren zu beobachten, dass Akademikern mit verwandten Themen eine Expertise zugestanden wird, die sie nicht innehaben. Klar, eine Kinderärztin ist natürlich auch Medizinerin. Aber eine ausgewiesene Expertin auf dem Fachgebiet von Covid-19-Behandlungen oder Epidemiologin ist sie damit längst noch nicht. Expertise ist von jenen Ärzten und Forschern anzunehmen, die sich nachweislich und direkt mit dem Gebiet beschäftigen, über das sie kommentieren. Hat ein Forscher etwa im Zuge der Ebola-Epidemie in Westafrika gearbeitet, ist er sehr wohl imstande, Epidemie- und Pandemie-Ausbreitung zu kommentieren. Ein Hausarzt dagegen nicht unbedingt, sofern er nicht mit entsprechenden Ausbrüchen in Kontakt gekommen ist.

Ich bin berühmt, also hab ich Recht

Fälschlich zuerkannter Expertise geht ein logischer Fehlschluss voraus, der Argumentum Ad Verecundiam heißt. Man schreibt jemandem (etwa Wissenschaftlern wegen der Titel, oder Promis wegen ihres Ruhmes) aus Ehrfurcht zu, dass ihre Aussagen wahr seien. Logisch-wissenschaftlich betrachtet ist das natürlich vollkommener Unsinn. Weil jemand eine Autorität ist, muss derjenige seine Aussagen dennoch beweisen können. Die Tatsache allein, dass jemand in der Vergangenheit Recht hatte oder einfach nur bekannt/berühmt ist, heißt noch lange nicht, dass aktuelle Aussagen stimmen müssen. Dass wir solchen Irrglauben aufsitzen, liegt kognitiver Verzerrung zugrunde und ist zutiefst menschlich. Diese Verzerrung ist unter anderem dafür verantwortlich, dass wir versuchen, unsere vorgefassten Meinungen mittels Rosinenpicken zu bestätigen. Dabei wählen wir tendenziell Quellen aus, die unsere Ansichten bestätigen und ignorieren solche, die unseren Ansichten widersprechen (Confirmation Bias). Das gilt übrigens genauso für die Auswahl von Quellen in wissenschaftlichen Arbeiten. Die Wissenschaft ist also weder absolut objektiv noch vor solchen Fehlschlüssen gefeit.

Astrophysiker Carl Sagan schreibt in seinem Buch “The Demon-Haunted World”:

“One of the great commandments of science is, ‘Mistrust arguments from authority’ […] Authorities must prove their contentions like everybody else.”

Falsche Autorität: Keine Ahnung, aber eine Meinung

Das gilt für ausgewiesene Experten in einem Fachgebiet. Falsche Autorität macht das Ganze noch um eine Stufe schlimmer. Dabei werden Menschen zitiert und kommentieren über Themen, von denen sie keinen Schimmer haben. Das passiert oft dann, wenn jemand, um seine Thesen zu untermauern, vermeintliche “Experten” aussucht, die zwar irgendetwas zum Thema gesagt haben aber einfach nur auf Grund ihres sozialen Status und Bekanntheitsgrades zum Zug kommen. Auch, wenn sie fachfremd sind. Beispiele dafür gibt es tonnenweise. Elon Musk etwa behauptete bei Joe Rogan, die tatsächliche Sterblichkeitsrate von mit Sars-CoV-2-Infizierten sei wesentlich geringer als von der WHO kommuniziert. Solche Aussagen sind zweifach gefährlich. Erstens, weil Musk eine große Fangemeinde hat, die solchen Aussagen blind vertraut. Und zweitens, weil Musk unmöglich imstande ist, qualifizierte Aussagen über das Thema zu treffen. Gefährlich ist das auch deshalb, weil Menschengruppen, die ohnehin schon an den Maßnahmen zweifelten, derartige Aussagen als Bestätigung nehmen, sich über moralische Verpflichtungen und geltendes Recht hinwegzusetzen.

Falsche Autorität und das Ehrfurchtsargument unter dem Deckmantel der Wissenschaft werden auch gerne in der Werbebranche missbraucht. Kosmetikhersteller Colgate-Palmolive UK erhielt 2007 mehrere Beschwerden des Werberegulierers ASA, weil er fälschlicherweise behauptet hatte, dass 80 Prozent der Zahnärzte Colgate-Zahnpasta empfehlen würden.

Kaum fällt das Wort Wissenschaft, öffnen sich alle Türen und Brieftaschen. Innerhalb der Wissenschaftsberichterstattung gibt es ähnliche Phänomene, so auch das so genannte Name-dropping: Werden bestimmte Personen, Institutionen oder Fachpublikationen genannt, gelten diese oft als intrinsisch glaubwürdig, was im Prinzip derselbe Fehlschluss ist wie das Ehrfurchts- und Autoritätsargument. Dadurch können leicht falsche Informationen aus der Wissenschaft in den Medien landen.

Als Wissenschaftsjournalist bemerke ich das immer wieder. Für meine Arbeit muss ich Studien lesen. Viele davon. Schlage ich als Freiberufler einen Text vor und nenne meine Quellen, geben sich die meisten Redakteure damit zufrieden, wenn ich die Studien als belegen kann. Viele fragen noch nicht einmal nach, ob es sich überhaupt um eine peer-reviewte Studie handelt. Dabei gibt es viele unseriöse Fachjournals, in denen fragwürdige Studien erscheinen. Die Qualität der Methoden stellt medial sowieso kaum jemand in Frage. Innerhalb der Wissenschaft schon: Beim Peer Review nehmen unabhängige Wissenschaftler die Studie näher unter die Lupe. Das System ist zwar die momentan beste Qualitätsüberprüfung, aber sie ist einigermaßen fehleranfällig. Das fängt damit an, dass auch die Prüfer aus Interessenskonflikten Studien akzeptieren oder zurückweisen.

Wenn ich also einen Text abliefere, liegt es allein in meiner Verantwortung, fehlerhafte Forschungsmethoden und Fehlschlüsse ausfindig zu machen, und zwar auch in peer reviewten Studien. Den Redaktionen, die die Texte abnehmen, reicht meistens die Studie mit Quellenangabe und der Nachweis, dass diese das Qualitätssiegel „Peer Review“ trägt (mit seiner Aura an Objektivität). Wie sehr das täuschen kann, zeigt sich daran, wie viele Studien jährlich von den Fachjournals zurückgezogen werden. Das kann viele Gründe haben, meistens sind es aber manipulierte Daten und ethische Verstöße. Der deutsche Anästhesiologe Joachim Boldt etwa hat nachweislich Daten erfunden, weswegen mehr als 90 seiner Studien zurückgezogen wurden. Alle hatten erfolgreich den Peer Review durchlaufen. Er galt als absolute Autorität auf seinem Gebiet.

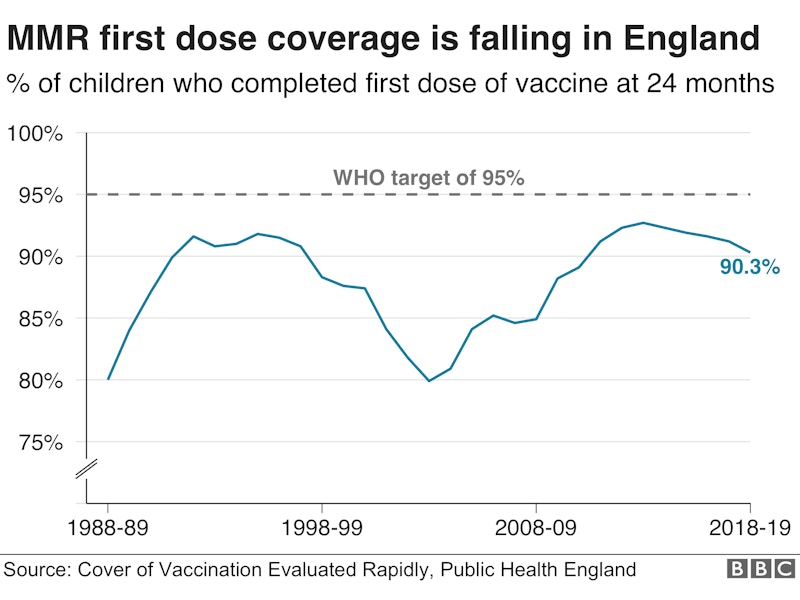

Noch gefährlicher werden Verzerrungen, wenn falsche Autorität auf Interessenskonflikte trifft. Wissenschaftler können nicht nur akademisch unqualifiziert sein, bestimmte Themen zu kommentieren. Wenn sie nebenbei an Hokuspokus glauben, sollte das alle Alarmglocken schellen lassen. Bei Dr. Stella Immanuel wäre das ihr blinder Glaube an Verschwörungstheorien und ihre tiefe Religiosität. In anderen Fällen gibt es Studien, die von Lobbys finanziert werden und entsprechend verzerrte Resultate liefern, die vom Unabhängigkeitsbestreben echter Wissenschaft weit entfernt sind. Prominentes Beispiel ist eine Lancet-Studie von 1998, deren Autor behauptete, dass Impfungen im Zusammenhang mit Autismus stehen. The Lancet zog die Studie erst zwölf Jahre später zurück, nachdem bewiesen wurde, dass die Schlüsse von Studienleiter Andrew Wakefield falsch sind und die Studie von Impfgegnern finanziert worden war. Der Brite Wakefield verlor seine Approbation in Großbritannien, ließ sich aber als Arzt in den USA nieder, wo er regelmäßig bei Anti-Impfpflicht-Demonstrationen als Redner auftritt. Der Schaden, den ein solcher “Experte” zuerst mit seiner falschen Studie und dann mit seinen gefärbten Auftritten bis heute verursacht, ist immens. Die Impfraten fielen nach dem Erscheinen der Wakefield-Studie merklich.

Unerfreulich: Nach der Veröffentlichung in “The Lancet” fiel die Impfrate in England deutlich. Erst 2012 erreichte sie wieder den Stand vor Wakefields falschen Forschungsergebenissen. Quelle: BBC

Dass Wissenschaftler auch nur Menschen sind, ist klar. Dass Interessenskonflikte auftreten, ebenso. Deswegen gibt es Kontrollorgane wie den Journalismus, der die Wissenschaft entsprechend zur Rechenschaft ziehen müsste. Leider passiert das oft nicht oder nur sehr schlecht, gerade in der Wissenschaftsberichterstattung. Der Löwenanteil der Wissenschaftsgeschichten konzentriert sich auf schnelle „Gee Whiz“-Darstellungen mit Wow-Effekt, also dem Verkünden neuer Durchbrüche von Technik und Forschung. Kritische Fragen stellen die Journalisten dabei oft nicht. Solche Sensationsdarstellungen haben zwei Vorteile: Sie sichern das Interesse der Leser, und sie kosten nicht viel. Es ist einfach und schnell, einfach Pressemitteilungen mit vorgefertigten Zitaten nachzuplappern. Lange, kritische Investigativstücke dagegen brauchen Zeit, kosten Geld und sind oft unangenehm. Dabei hätten Journalismus und Wissenschaft, wenn sie ordentlich gemacht werden, durchaus einige Parallelen, darunter ein hohes Maß an Kritik und Kritikfähigkeit, dass sie nichts für bare Münze nehmen, sondern Nachweise verlangen, und dass sie nachvollziehbar und korrekt sein sollten. Idealerweise. Manchmal geht das aber daneben.

Das ist etwa dann der Fall, wenn Journalisten versuchen, mediale Balance herzustellen, während in der echten Welt keine solche Balance vorherrscht. Das Problem ist so bekannt, dass es einen eigenen Namen verpasst bekommen hat: False Balance, eine Form medialer Verzerrung. Die passiert, wenn Journalisten „fair“ sein wollen, allen Beteiligten eine Stimme zu geben und, natürlich, um als objektive Berichterstatter dazustehen. Genau das ist aber besonders einer derartigen Auswahl über Wissenschaft der nächste Trugschluss. Bestes Beispiel dafür ist die Diskussion über menschgemachte globale Erwärmung. Immer wieder passiert es, dass Klimawandelleugner in Pro- und Contra-ähnlichen Interviewsituationen gleichermaßen wie seriöse Wissenschaftler zu Wort kommen. Das erweckt den Eindruck, dass die Diskussion in zwei gleich große und gleichermaßen gültige Lager aufgeteilt ist. Was völliger Humbug ist: 97 Prozent der seriösen Wissenschaftler geben dem Weltklimarat recht. Drei Prozent sind dagegen. Für die Leser und Zuschauer sieht es aber so aus, als wären würden sich die Argumente die Waage halten.

Waffelbrüder im Kampf gegen Covid-19

Diese Fehlschlüsse treten übrigens oft gleichzeitig auf. So auch in einem kürzlich erschienenen Radiobeitrag der Sendung “12 nach 12” auf RAI Südtirol, in der Journalist Wolfgang Mayr den Unternehmer Hannes Loacker zu seinen Ansichten über die Covid-19-Pandemie zu Wort kommen lässt. Loacker ist Teil der gleichnamigen Südtiroler Waffel-Dynastie und hat früher homöopathische Mittel erst importiert und dann selbst produziert und vertrieben. Mittlerweile arbeitet er mit Familienmitgliedern in der Bioweinproduktion, in der laut Eigenangaben ebenfalls Homöopathie zum Einsatz kommt. Hannes Loacker ist studierter Pharmazeut. Mit seinen Kommentaren darüber, dass es sich um eine “so genannte Pandemie” handele (nicht im RAI-Podcast, sondern in einem Facebook-Post), mit seinen Aussagen, dass unter anderem Händewaschen übertrieben sei, und mit seiner als Märchen formulierten Parodie auf der Meraner “Freiheitsdemo” Ende Mai, in der er die Krise inmitten von Impfgegnern durch den Kakao zog.

Unwirksam: Homöopathie wirkt einzig und allein über den Placeboeffekt. Die absurde Logik: Je mehr man einen angeblichen Wirkstoff verdünnt und dann verschüttelt, desto besser wirke das “Medikament”.Das ist falsch. Es handelt sich in hohen Potenzen (also den angeblich wirksamsten Globuli) um reine Milchzuckerkugeln mit keinem einzigen wissenschaftlich nachweisbaren Wirkstoff-Molekül. Foto: Tim Reckmann | a59.de

Loacker bekommt implizit die Aura eines kommentarfähigen Experten verliehen. Diese falsche Autorität fußt aber auf seinem (in puncto Covid-19) fachfremden Studium und auf dem Bekanntheitsgrad seines Clans. De facto ist er außerstande, die Corona-Krise kompetent zu beurteilen und Ratschläge in puncto Hygienemaßnahmen oder gar politische Entscheidungen zu geben. Er ist weder Pandemieforscher noch Virologe noch Epidemiologe. Lustig wird der ganze Mummenschanz, als sich Loacker auf den ehemaligen Leiter des Institutes für Mikrobiologie und Hygiene der Johannes Gutenberg-Universität Mainz, Sucharit Bhakdi, als Experten in Sachen Covid-19 beruft. Was wieder ein Fehlgriff ist, denn Loacker bezieht sich auf Bhakdis virales Video, in dem dieser Behauptungen aufstellt wie jene, dass das Sars-CoV-2-Virus nicht gefährlicher als das Grippevirus sei (Bullshit) und Impfstoffe sinnlos, weil das Virus mutiere (Bullshit²). Correctiv hat sieben von Bhakdis Aussagen einem Faktencheck unterzogen, in dem sich fast alle der getesteten Behauptungen als unbelegt herausgestellt haben, eine sogar als pauschal falsch. Loacker aber greift Bhakdis Kernaussagen mehrfach auf und stellt diese als wahr dar.

Weil er also fragwürdige Theorien vertritt und die Auswüchse der Corona-Krise per se anzweifelt (“so genannte Pandemie”), hätte er nicht für ein derartiges Interview ausgesucht werden dürfen. Auswahl ist Journalistensache. Nicht, dass man keine polarisierenden Gäste einladen dürfte. Aber wenn man es macht, muss für das Publikum offensichtlich sein, wie hoch der Wahrheitsgehalt deren Argumente ist. Das zu gewährleisten (etwa durch kritische Fragen und klärende Statements) ist ebenfalls Aufgabe des Journalisten. Die Wortwahl wie “Sanitätsfaschisten”, wäre zudem ein weiteres Indiz dafür gewesen, ihm keine Bühne bereitzustellen. Dazu müsste der Journalist aber seine Hausaufgaben machen und tief genug in die Thematik eindringen, bevor er ein Interview führt. Ansonsten ist es kein Wunder, dass die Fragen an der Oberfläche herumdümpeln. Nach dem Erscheinen einer kritischen Kolumne über das Interview verwies Loacker auf ein weiteres Scheinargument: Die Autorin der Kolumne solle sich doch anschauen, wie viele Menschen ihm auf dem Facebook-Post zum Interview Recht geben. Ein perfektes Beispiel für den nächsten Fehlschluss.

Unter polarisierenden Facebook-Posts entsteht häufig der Eindruck, es gebe bloß zwei Meinungen. Es gibt häufig Kommentare, aber in der Regel stechen zwei an oberster Stelle heraus. Ein Kommentar mit vielen Likes, und ein Gegenkommentar mit immer noch vielen, aber weniger Likes. So entsteht schnell der Eindruck, dass die Fraktion mit den meisten Likes Recht hat. Ein Trugschluss, der sogar einen eigenen Namen trägt. Argumentum ad populum ist der Versuch, Legitimation über Zustimmung zu erreichen. Wenn möglichst viele Leute zustimmen, wird’s schon stimmen. Nein. Tut es eben nicht. Auch die Masse kann sich irren. Sofern man die paar Dutzend Facebook-Likes unter Loackers Post überhaupt als Masse bezeichnen kann. Und auch wenn es tausend oder eine Million gewesen wären: Das hat nichts mit dem Wahrheitsgehalt des Beitrages zu tun.

Anekdotische Evidenz: Ich hab gehört…

Expertise wird aber auch gänzlich unwissenschaftlichen Menschen zugeschrieben, die über anekdotische Evidenz Beweise für Phänomene liefern. Ebenfalls im Interview mit “Südtirol Aktuell” kommt Impfgegnerin Stefanie Brugger zu Wort, die eine Geschichte aus zweiter Hand erzählt: Ein Kind einer Freundin sei direkt nach einer Impfung beim Arzt mit schwersten Behinderungen aus der Praxis gekommen. Das ist zwar schwer vorstellbar, dummerweise aber auch schwer zu widerlegen. Die Menge an solchen Anti-Impf-Anekdoten ist groß, und der Effekt auf die Zuschauer groß, einerseits wegen des Confirmation Bias, andererseits, weil derartige Geschichten stark emotionalisieren. Besonders nach der Wakefield-Studie sind solche Geschichten vermehrt aufgetreten. Immerhin, das Argumentum Ad Populum kann Brugger nicht geltend machen, weil sie die Unterstützer im Dorf gerade mal an einer Hand abzählen kann.

Anekdotische Evidenz ist kein Beweis für irgendetwas. Es ist Hörensagen. Es sind Geschichten mit einer ungeheuren Überzeugungskraft. Klar, in manchen Fällen werden Anekdoten stimmen, aber zur wissenschaftlichen Beweisführung taugen sie in den meisten Disziplinen nichts. Gefährlich werden sie allerdings dann, wenn sie zur “Beweisführung” benutzt werden und aus einem Einzelfall verallgemeinernde Schlüsse gezogen werden. Besonders häufig sitzen Impfgegner dem Trugschluss auf, dass nur, weil zwei Beobachtungen gleichzeitig oder kurz nacheinander auftreten, sie in Verbindung miteinander stehen. Das muss aber nicht so sein und hat deshalb einen eigenen Namen erhalten: Der Post hoc ergo propter hoc-Trugschluss, also “es passiert danach, also deshalb”. Nur weil der Hahn immer kurz vor Sonnenaufgang kräht, geht die Sonne nicht auf, weil er kräht. Der post hoc-Trugschluss steht häufig mit Aberglauben in Zusammenhang.

Es gibt ellenlange Listen an Scheinargumenten und logischen Fehlschlüssen. Argumentum Ad Nauseam (Wiederholung bis zum Übelsein, Trump nimmt das gerne) oder das ebenfalls populäre Argumentum Ad Ignorantiam (“Du kannst mir nicht das Gegenteil beweisen, ätsch”, Abergläubische und Pseudowissenschaftler ziehen dieses Argument gerne heran). Wichtiger aber noch als die Frage, mit welchen Mitteln getrickst wird, ist diese hier: Was wollen die falschen Experten erreichen? Derartige Fragen zu stellen und den Grund hinter den Falschaussagen herauszufinden, ist die Aufgabe guter Journalisten. Im vorliegenden Fall und auch in vielen anderen Fällen ist das nicht passiert. Dabei wäre die Frage einfach: Was verdient ein Interviewter daran, solche Theorien zu verbreiten? Bhakdis und Püschels und wie sie alle heißen, gibt es genug. Sogar Virologe Christian Drosten kritisiert die Kollegschaft, ohne bestimmte Namen zu nennen.

Oft liegt die Antwort beim lieben Geld. Wakefield etwa hat Millionen damit verdient, Nahrungsergänzungsmittel als Alternativen in den USA zu verkaufen. Dass Homöopathie völlig überteuerte Zuckerkügelchen ohne nachweisbaren Wirkstoff und ohne pharmazeutische Wirkung sind, ist genauso klar. Bhakdi verkauft gerade sein Buch “Corona – Fehlalarm?”, das er mit seiner Frau geschrieben hat. Das muss ja schließlich promotet werden. Dabei geholfen hat ihm Hannes Loacker, der gleich hundert Exemplare davon auf Facebook zum Verschenken anbot. Was es denn speziell für ihn mit seiner Kampagne zu verdienen gibt? Vielleicht trifft er ja irgendwann auf einen kritischen Journalisten, der das herausfindet.

Meinungsfreiheit ist ein wichtiger Grundwert, den es zu verteidigen gilt. Nur, so inflationär wie von Impfgegnerfraktionen und sonstigen Verschwörungstheoretikern verwendet, verkommt der Begriff ebenfalls zum Scheinargument. Ich werde mir nicht anmaßen, hier zu definieren, wie weit Meinungsfreiheit gehen darf. Ich bin kein Jurist. Nur soviel: Es gibt länderspezifische Grenzen dafür. Diese Grenzen beinhalten fast überall Beleidigung, Diffamierung, Hassrede, Drohungen, aber auch die öffentliche Sicherheit. Und die öffentliche Sicherheit steht in dieser Pandemie ganz offensichtlich auf dem Spiel. Und die Infodemie, die sich wie ein Parasit in die Pandemie gebissen hat, trägt ihres dazu bei, diese öffentliche Sicherheit zu gefährden. Überhaupt: Wer einseitig dazu auffordert, “wer meiner Meinung ist bitte direkt auf dem Post von Rai Südtirol kommentieren”, kann so viel von Meinungsfreiheit nicht halten.

Wenn ich mir also so anschaue, wie einer einerseits Biowein und Bioprodukte verkauft und andererseits gegen die ganze böse Chemie wettert und gleichzeitig Tipps für gesunde Ernährung verteilt, wäre ich fast schon versucht, dahinter eine Verkaufsagenda zu vermuten. Vor allem dann, wenn der Herr Experte noch dazu “langjährige Erfahrung in Unternehmens- und Mitarbeiterführung im Bereich Marketing und Vertrieb” hat.

Aber Stop! Das wäre ein logischer Fehlschluss, also lassen wir das lieber.

|

Martin W. Angler ist Wissenschaftsautor und schreibt über Forschung und Technik. Zwischendurch schreibt er auch Bücher und hält Workshops über Blogging und Storytelling. |

Citation

This content is licensed under a Creative Commons Attribution 4.0 International license except for third-party materials or where otherwise noted.